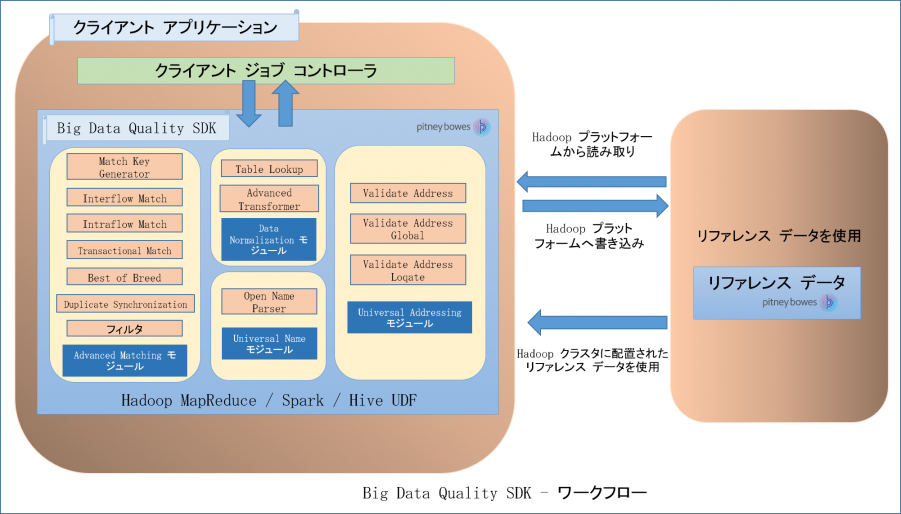

ワークフロー

SDK を使用するには、次のコンポーネントが必要です。

- Big Data Quality SDKのインストール

- Big Data Quality SDKの JAR ファイルをシステムにインストールし、アプリケーションで使用できるようにする必要があります。

- クライアント アプリケーション

- SDK を使用して必要なデータ品質操作を呼び出して実行するために作成する必要がある Java アプリケーション。Big Data Quality SDKの JAR ファイルを Java アプリケーションにインポートする必要があります。

- Hadoop プラットフォーム

- Big Data Quality SDKを使用してジョブを実行する際、まず、設定済みの Hadoop プラットフォームからデータが読み込まれ、関連する処理が実行された後、出力データが Hadoop プラットフォームに書き出されます。

このため、使用するマシンで Hadoop のアクセスの詳細情報を正しく設定しておく必要があります。詳細については、概要を参照してください。

- リファレンス データ

- Big Data Quality SDKで必要なリファレンス データは、Hadoop クラスタに配置されます。

- Java API

-

Java API を使用する場合は、次のいずれかの場所にリファレンス データを配置できます。

- ローカル データ ノード: リファレンス データはクラスタ内の使用可能な全てのノードに配置されます。注: これはフェイルセーフな方法とはいえません。

- Hadoop Distributed File System (HDFS): リファレンス データは HDFS ディレクトリに配置されます。この方法では、データがフェイルセーフに保管されます。

- ローカル データ ノード: リファレンス データはクラスタ内の使用可能な全てのノードに配置されます。

- Hive UDF

- Hive UDF を使用する場合は、リファレンス データをクラスタの各ローカル データ ノードに配置する必要があります。

注: また、この SDK では、パフォーマンス向上のための分散キャッシュを実行できます。